TriAttention深度解析:MIT韩松团队如何用三角函数让单卡4090跑出百万Token上下文

2026-04-17 10:15:58 +0800 CST view 248

AI Agent 修 Bug 的隐秘成本:斯坦福研究揭示编码任务中 Token 消耗的惊人真相

2026-05-08 11:38:56 +0800 CST view 181

SGLang vs vLLM:2026年大模型推理框架深度对比与选型指南

2026-04-08 15:51:53 +0800 CST view 933

Caveman 深度解析:让 AI 告别废话,65% Token 节省背后的工程智慧

2026-04-08 17:25:16 +0800 CST view 648

5个实战PHP一行代码技巧:告别重复判断、循环和格式转换

2026-04-27 21:04:10 +0800 CST view 111

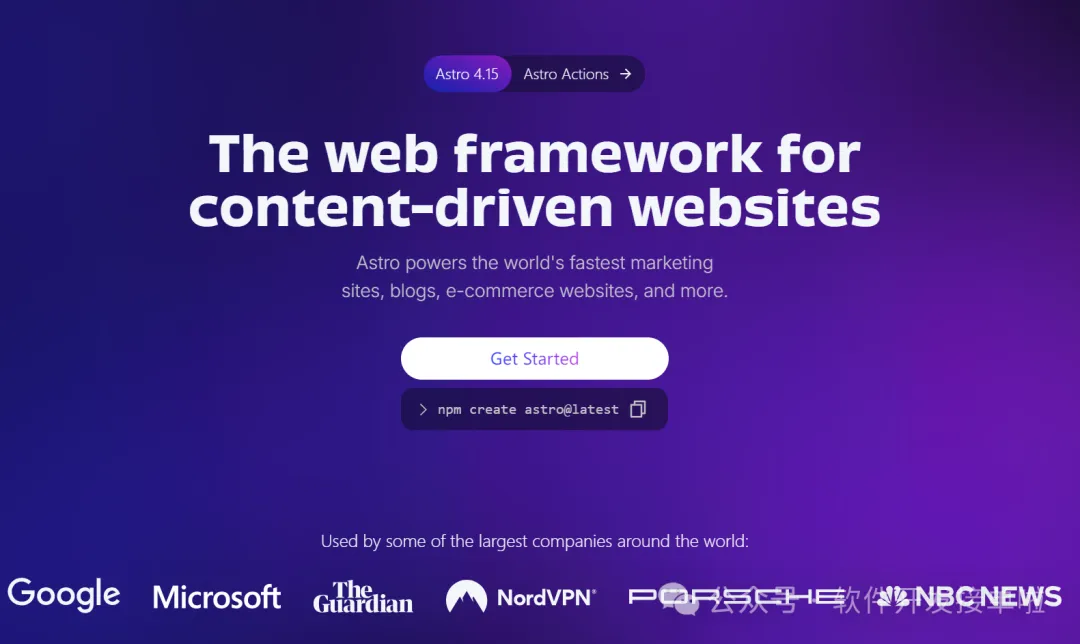

Astro是一款现代的JavaScriptWeb框架,特别适合构建内容驱动型网站,如博客和企业官网

2024-11-18 16:13:37 +0800 CST view 2265

2026 大模型推理优化:TensorRT-LLM v0.19 + Blackwell + 低比特量化实战手册

2026-04-09 03:15:44 +0800 CST view 417