分布式 LLM 推理架构深度实战:从 vLLM 单节点到 llm-d 多集群的生产级演进全链路解析

2026-05-09 03:39:58 +0800 CST view 10

goctl 技术系列 - Go 模板入门

2024-11-19 04:12:13 +0800 CST view 1375

DeepSeek 专家模式深度解析:当低调更新成为AGI赛道的产品哲学宣言

2026-04-09 10:23:56 +0800 CST view 267

从零实现一个简化版JS引擎的基本步骤

2024-11-19 05:49:01 +0800 CST view 1242

LiteRT-LM:Google端侧大模型推理引擎的革命性架构——从TensorFlow Lite的困境到LLM原生推理的全链路解析

2026-04-19 22:17:39 +0800 CST view 273

MCP 2026 深度解析:AI推理性能瓶颈诊断的12个隐性耗时陷阱——从TensorRT-LLM到vLLM再到Triton的全引擎实战

2026-04-30 14:21:13 +0800 CST view 119

当 Apple Silicon 遇上视觉大模型:MLX-VLM 如何把「本地多模态推理」变成现实

2026-04-11 10:24:48 +0800 CST view 361

TurboQuant + RWKV-6:AI 推理效率双重突破——从内存压缩到线性架构,大模型部署范式的革命性重构

2026-04-20 10:46:48 +0800 CST view 156

LLM推理引擎终极对决:vLLM vs TensorRT-LLM深度解析与2026生产环境选型指南

2026-04-20 13:45:31 +0800 CST view 213

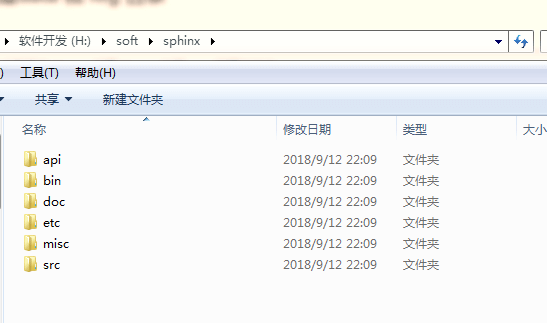

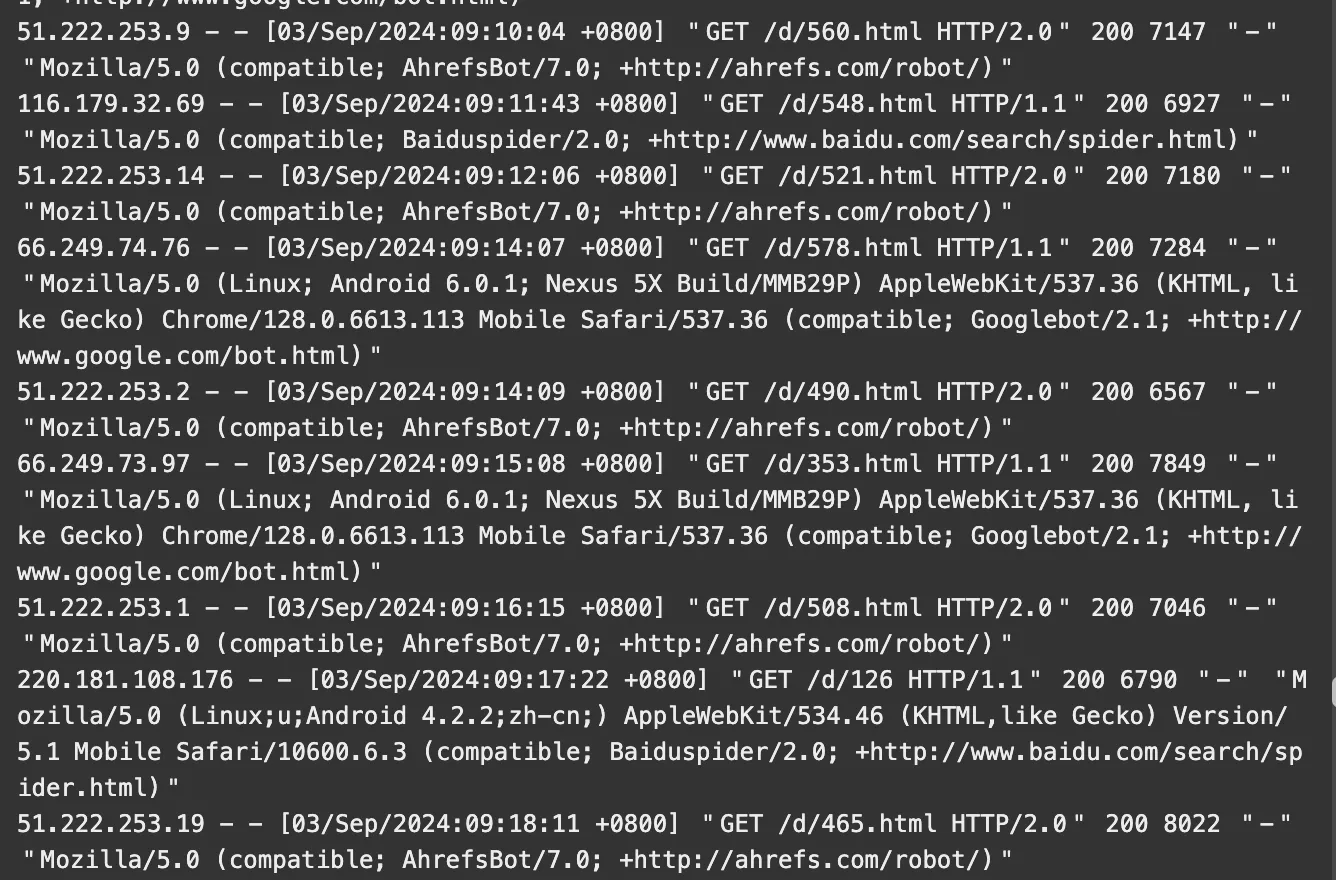

windows安装sphinx3.0.3(中文检索)

2024-11-17 05:23:31 +0800 CST view 4463

Evolver深度解析:GEP协议如何让AI Agent获得基因进化能力

2026-04-20 15:47:54 +0800 CST view 139

我为什么越来越少打开百度和谷歌?因为发现了这个开源搜索神器:SearXNG

2025-07-17 18:05:30 +0800 CST view 1248

robots.txt 的写法及用法

2024-11-19 01:44:21 +0800 CST view 1477

MOSS-TTS-Nano:0.1B参数纯CPU实时语音生成与克隆,MacBook Air单核就能跑

2026-04-20 22:53:28 +0800 CST view 448

DeepGEMM 深度解析:DeepSeek 开源的 FP8 GEMM 内核如何重塑 AI 推理性能边界

2026-04-21 05:16:09 +0800 CST view 274

WebAssembly 深度实战:从浏览器端 AI 推理到 Serverless 容器——2026 年 WASM 如何重塑云原生与前端边界

2026-05-02 09:03:59 +0800 CST view 229

River-LLM 深度解析:上交大如何让大模型推理速度翻倍,却几乎不损失精度

2026-05-02 19:05:49 +0800 CST view 81

Archon 深度解析:当 AI 编码进入「工程化 Harness」时代——首个开源工作流引擎如何让 AI 编程从玄学变科学

2026-04-12 18:54:54 +0800 CST view 180

LRT 隐式思维链深度解析:当 AI 学会「静默思考」,推理效率提升数十倍的工程革命

2026-04-12 21:54:21 +0800 CST view 294

vLLM 2026 深度解析:从 PagedAttention 到多节点分布式推理的全链路技术实战

2026-05-03 15:13:07 +0800 CST view 107

Helios深度解析:北大袁粒团队如何用14B参数重塑实时视频生成——从架构革命到工程落地的全解

2026-04-13 05:23:52 +0800 CST view 325

大模型部署太慢?这个超级引擎帮你搞定!SGLang速通指南

2026-04-22 09:27:57 +0800 CST view 189

英特尔至强6 + SambaNova RDU:异构AI推理架构如何重新定义Agentic计算

2026-04-13 14:53:38 +0800 CST view 255